Грозит ли генеративному искусственному интеллекту дефицит электричества

Какие решения и технологии помогут решить проблему энергодефицита ИИ

Конец минувшего года омрачился рядом негативных прогнозов в отрасли искусственного интеллекта (ИИ). Так, глава ключевой компании отрасли OpenAI Сэм Альтман заговорил о дефиците ресурсов. Отвечая на вопрос в чате Reddit в октябре 2024 г. о длительных сроках работы над следующими моделями ИИ, он заявил: «Эти модели становятся все сложнее, и мы сталкиваемся со множеством ограничений, вынуждающих нас принимать непростые решения о том, как распределять вычислительные ресурсы между различными многообещающими проектами».

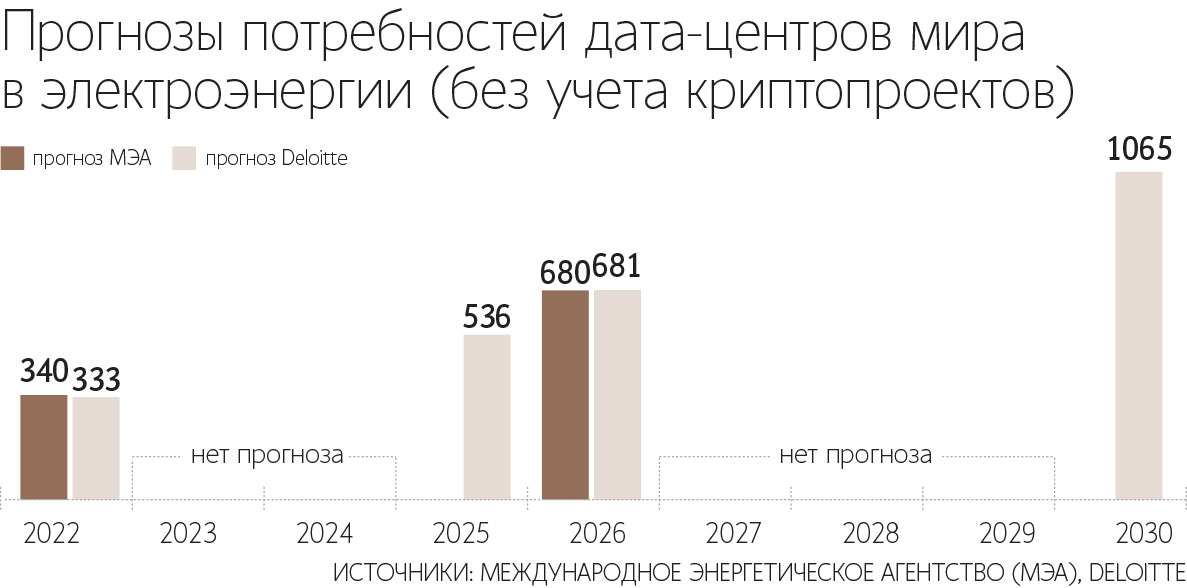

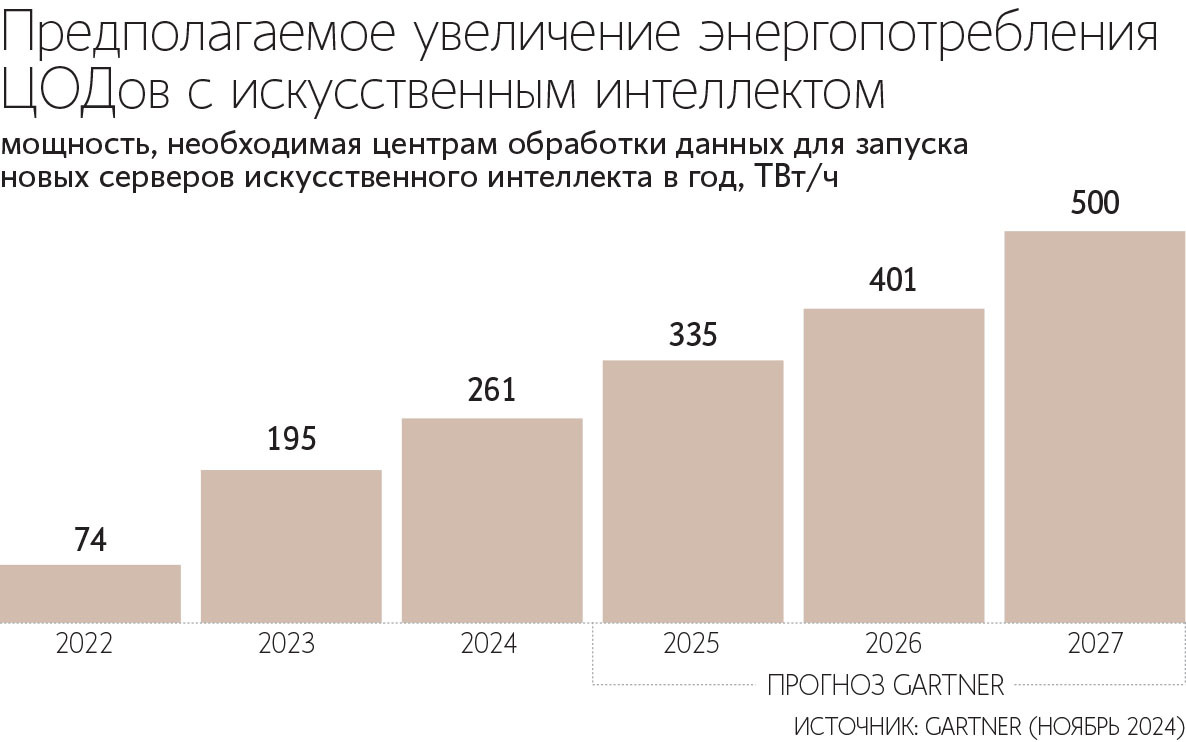

Буквально через месяц после слов Альтмана вышел аналитический отчет консалтинговой компании Gartner. В нем было написано, что к 2027 г. до 40% дата-центров, обслуживающих системы ИИ, могут столкнуться с дефицитом электроэнергии, что ограничит их функционирование. В Gartner подсчитали, что к этому году для работы ИИ-серверов потребуется дополнительно около 500 ТВт·ч электроэнергии, что в 2,6 раза больше, чем в 2023 г. (для сравнения: вся электроэнергетика России вырабатывает 1151 ТВт·ч в год).

В ноябре 2024 г. эксперты Deloitte и Международного энергетического агентства также озвучили свои сценарии: они ожидают удвоения всех потребностей дата-центров в электроэнергии уже к 2027 г. – и тоже главным образом из-за спроса в динамичном сегменте генеративного ИИ.

В Nature обозначили эту проблему, назвав ее «энергетический кризис ИИ». «Лишь снизив потребление энергии при развитии ИИ, мы не увидим проблем в развитии этой технологии», – подтвердили научные сотрудники Intel Lab.

Однако в ИИ-отрасли пока не чувствуется паники, там предлагают дождаться новых энергосберегающих решений и технологий.

Уперлись в потолок

«Энергетика – это стена, в которую очень скоро упрутся разработчики ИИ, если подход в этой отрасли будет основан просто на масштабировании современных моделей. Уже в ближайшие годы для центров обработки данных нужно будет строить кластеры, которые станут потреблять десятки гигаватт энергии», – рассказывает Станислав Страупе, руководитель сектора квантовых вычислений Центра квантовых технологий физического факультета МГУ и руководитель научной группы Российского квантового центра.

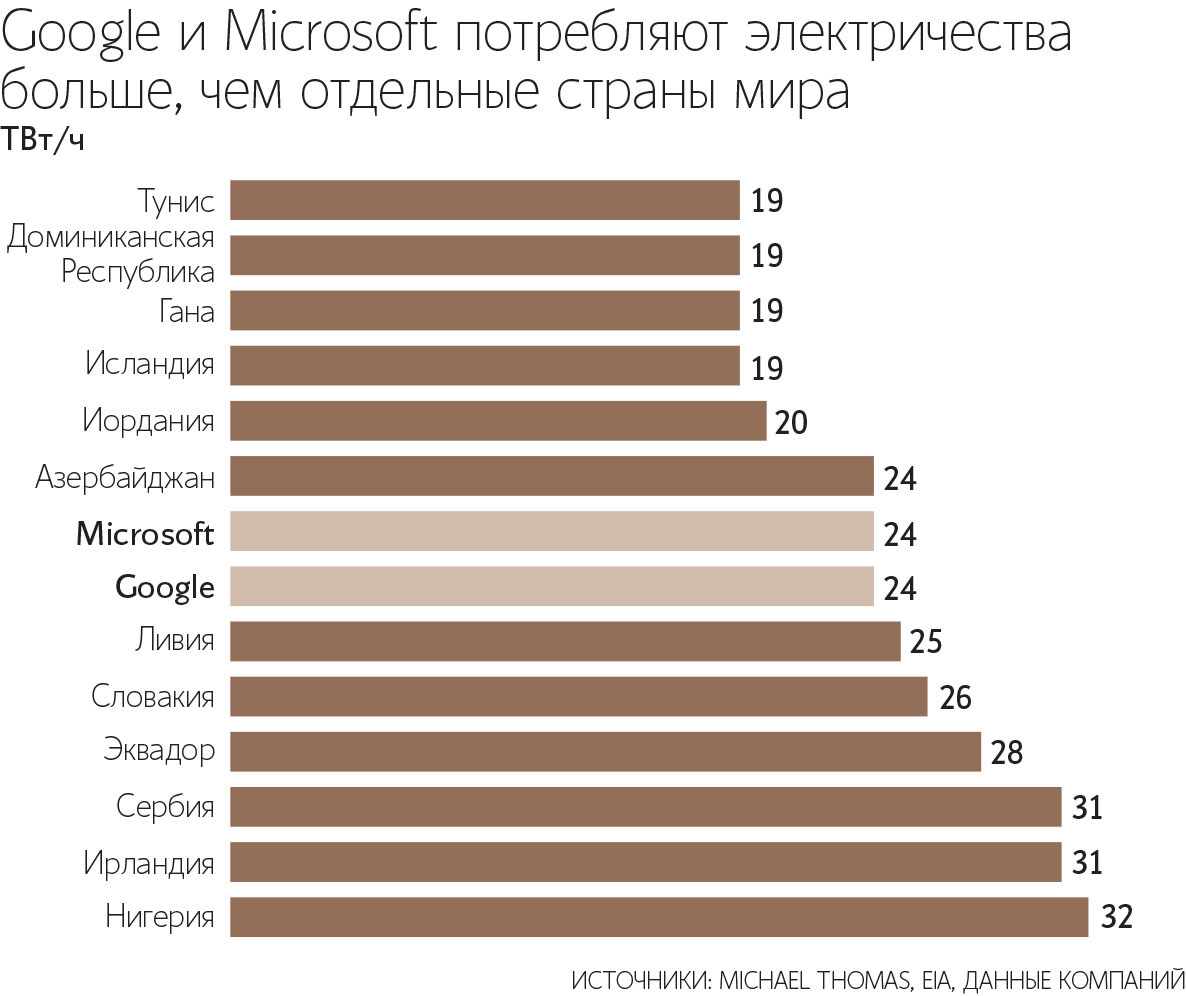

Действительно, сейчас на каждый стандартный поиск Google использует 0,3 Вт·ч электроэнергии, а на одно взаимодействие с нейронным ботом ChatGPT тратится в 10 раз больше – 3 Вт·ч, подсчитали в SemiAnalysis. Поэтому, когда Google заявил о внедрении в каждом своем поисковом запросе ИИ, аналогичного ChatGPT, аналитики подсчитали, что в текущих условиях для этого потребуется более 512 000 серверов NVIDIA HGX A100. При потребляемой мощности в 6,5 кВт на сервер это означает ежедневное потребление электроэнергии в размере 80 ГВт·ч, а годовое – в размере 29,2 ТВт·ч. Для сравнения: столько энергии сейчас потребляет Ирландия.

«ИИ оказался весьма прожорливой с точки зрения электропотребления системой. Мы ждем огромного роста спроса на электричество. Такого роста не было целое поколение», – говорят в Goldman Sachs. По прогнозам инвестбанка, к 2030 г. в США дата-центры будут потреблять 8% от общей мощности энергосистемы страны по сравнению с 3% в 2022 г. Чтобы поддержать растущий спрос на электричество, США придется инвестировать около $50 млрд в новые энергомощности.

По данным Международного энергетического агентства, мировое потребление электроэнергии центрами обработки данных в 2022 г. составляло 240–340 ТВт·ч, или около 1–1,3% от мирового конечного спроса на электроэнергию. Это не считая энергии, используемой для майнинга криптовалют, которая в том же году составила около 110 ТВт·ч – еще 0,4% от мирового потребления электроэнергии. Агентство прогнозирует, что к 2026 г. использование энергии центрами обработки данных вырастет в 2 раза.

Инвестиции в центры обработки данных и чипы ИИ в США могут превысить $700 млрд в год к 2030 г., что эквивалентно более 2% ВВП США, подсчитали в BlackRock Investment Institute. С учетом расходов на строительство энергетической инфраструктуры, необходимой для создания центров обработки данных, а также перехода на низкоуглеродную экономику общие инвестиции в США могут составить до $3 трлн к 2030 г. По масштабам это может быть похоже на промышленную революцию, оценивают аналитики BlackRock.

ИИ-энтузиасты просят успокоиться

Ключевые участники отрасли считают, что энергоемкие системы ИИ не являются поводом для беспокойства. Выступая летом 2024 г. в Лондоне, глава и совладелец Microsoft Билл Гейтс призывал «не переусердствовать» с опасениями по поводу огромного количества электроэнергии, которое потребуется для ИИ. По оценкам Гейтса, новые центры обработки данных приведут к росту глобального потребления электричества лишь на 2–6%.

Прошлые прогнозы экспоненциального роста потребления электроэнергии за счет IT были крайне неточными, подтверждает Даниэль Кастро, автор «белой книги» по использованию энергии ИИ для Фонда информационных технологий и инноваций в США. Кастро вспоминает, что незадолго до пика бума доткомов в 1990-х гг. журнал Forbes тоже обещал, что в течение следующего десятилетия половина электросетей будет обеспечивать цифровую интернет-экономику. «Но оценка была неверной, в ней были ошибки как в фактах, так и в методологии. На долю ЦОДов приходится около 1,5% мирового электропотребления», – пишет Кастро.

Кастро указывает также на постоянные улучшения, наблюдаемые в моделях и аппаратном обеспечении ИИ. Он приводит пример: через 18 месяцев после появления ChatGPT-3 от Open AI корпорация Google выпустила GLaM, языковую нейронную сеть с 1,2 трлн параметров. Несмотря на то что GLaM по параметрам была почти в 7 раз больше ChatGPT-3 и превосходила ее по производительности, для обучения ИИ от Google потребовалось уже в 2,8 раза меньше энергии.

Кастро обращает также внимание на то, что производители чипов продолжают создавать более эффективные графические процессоры для ИИ. Например, недавний переход Nvidia от одного поколения графических процессоров к другому привел не только к значительному ускорению обработки, но и почти к удвоению энергоэффективности.

Дмитрий Гусев, технический директор частной французской полупроводниковой компании Menta, также сомневается в негативных энергетических сценариях развития ИИ. По его словам, в основном много электричества потребляет именно обучение моделей генеративного ИИ. «Обучение фундаментальных генеративных моделей типа ChatGPT-4 действительно может стоить сотни миллионов долларов и тратить уйму энергии (длится месяцами на тысячах GPU). Для других типов моделей обучение значительно дешевле», – объясняет Гусев. Но, по его мнению, производительность фундаментальных генеративных ИИ выходит на плато. Сейчас десятки компаний пытаются создать свои фундаментальные модели, и это приводит к удешевлению методов их создания. «К тому же многие модели находятся в свободном доступе (например, Lama от Facebook (входит в Meta, которая признана экстремистской и запрещена в России)), и они вполне конкурентоспособны с ChatGPT. Думаю, в дальнейшем останется несколько стандартных моделей, которые все будут лицензировать или копировать. Спрос на обучение в таких масштабах, как сейчас, упадет», – отмечает Гусев.

По словам Гусева, проблема электричества для ИИ сейчас не в приоритете в отрасли. «Для меня это индикатор реального масштаба проблемы. Да, сегодня дата-центры потребляют порядка 1,5–2% электричества в мире. Тренд роста в 2 раза каждый год не кажется чем-то ужасным, да и этот тренд видится просто проекцией текущих расходов на обучение. А обучение не будет влиять вдолгую», – сказал Гусев.

Что касается использования ИИ-моделей для бизнес-задач (в отрасли это называется термином inference), то там тратится на порядки меньше энергии, чем на обучение ИИ. «Потребление энергии для inference будет сильно расти, если использование ИИ в бизнесе поднимется на индустриальные уровни», – объясняет Гусев. По его словам, дата-центры этой проблемой заняты давно и решения уже есть (например, замена GPU Nvidia специальными чипами).

Всего лишь 20 Вт

Помимо традиционной микропроцессорной гонки за энергоэффективностью в отрасли есть еще несколько направлений научно-технического поиска. Одно из перспективных – изыскания в области нейроморфных компьютеров.

Архитектура традиционных графических процессоров для ИИ строится на так называемой схеме фон Неймана, где разделяют память и процессор, обмениваясь данными по шине. Совместное использование шины для памяти программ и памяти данных создает узкое место в архитектуре фон Неймана, а именно ограничение пропускной способности между процессором и памятью по сравнению с объемом памяти. Это влечет высокое энергопотребление и задержки при передаче больших объемов данных. В нейроморфных чипах, напротив, упор делается на распределенные вычисления: множество искусственных нейронов и синапсов (место контакта между двумя нейронами, где они обмениваются друг с другом информацией) размещаются в единой среде близко друг к другу, что позволяет обрабатывать сигналы параллельно с минимальными задержками и меньшими затратами энергии. По сути, имитируется биологическая нервная ткань.

Мозгу нужно в тысячи раз меньше энергии, чем суперкомпьютерам: человеческий мозг при мощности 20 Вт выдает, по самым скромным оценкам, 11 петафлопсов. Для сравнения: японскому суперкомпьютеру Fugaku производительностью 442 петафлопса нужно 28 000 Вт электрической мощности.

Новые нейроморфные процессоры могут дать толчок развитию тех технологий, которым в первую очередь требуется сверхнизкое потребление энергии: нейроинтерфейсам, нейрочипам, нейроимплантам. «Думаю, что нейроморфные вычислительные системы будут особенно актуальны в портативных мобильных устройствах, где нужно выполнять огромное количество вычислений в режиме реального времени. Такие устройства будут окружать нас в любых областях жизни – от медицины до беспилотных транспортных систем», – считает Сусанна Гордлеева, профессор нижегородского Института Лобачевского, директор НИИ нейроморфного интеллекта IT-кампуса «Неймарк».

Рабочие прототипы нейроморфных компьютеров уже существуют. Лидером в этой области считается американская корпорация Intel, которая в апреле 2024 г. запустила в работу нейроморфный компьютер Hala Point. Он оснащен более чем 1000 нейрочипов Loihi 2, которые в 50 раз производительнее в задачах для ИИ по сравнению с самыми мощными компьютерами с традиционной архитектурой.

Основными игроками в России по разработке нейроморфных чипов и вычислений являются «Росатом» и Курчатовский институт, свои наработки есть в МГУ и МФТИ.

Технология изготовления нейроморфных чипов все еще находится в стадии экспериментов, до промышленных масштабов далеко. Все ограничено исследовательскими или пилотными партиями. По мнению Гусева, про переход на нейроморфные модели говорить пока рано. «Конвертация сегодняшних сверточных моделей в нейроморфные, чтобы удешевить пользование ИИ, конечно, может быть, но на горизонте 3–5 и более лет, не ранее», – считает он.

Нераскрытый квантовый потенциал

Часть ожиданий в снижении энергопотребления ИИ связана с другим направлением научно-технического поиска – квантовыми вычислениями. «Именно они смогут решить проблемы, которые обострились на фоне бума генеративного ИИ, – это нехватка центров обработки данных и все возрастающая потребность в энергии», – говорит Альберт Ефимов, вице-президент, директор управления исследований и инноваций Сбербанка. По его мнению, следующая технологическая революция произойдет именно благодаря синергии квантовых систем и ИИ.

В исследовании Массачусетского технологического института The Computational Limits of Deep Learning, опубликованном в 2020 г., тоже говорится, что качественный скачок ИИ станет возможен, если появятся рабочие квантовые компьютеры.

Действительно, в конце 2019 г. квантовый компьютер Google на новом процессоре Sycamore смог за 3 минуты 20 секунд выполнить расчет, на который самому мощному в мире суперкомпьютеру Summit (IBM) понадобилось бы примерно 10 000 лет. Sycamore в ходе эксперимента потребил энергии, примерно как обычная лаборатория (несколько десятков киловатт), а соревновался он с суперкомпьютером, установленная мощность под потребности которого – 13 000 кВт. Преимущество в энергоэффективности очевидно.

Квантовые компьютеры могут упростить и ускорить процесс классификации в массивах информации ИИ, найти в них закономерности, которые в разумные сроки не в силах обнаружить классический компьютер. Если классический компьютер для решения задачи рассматривает различные комбинации по очереди, то квантовый при помощи эффекта суперпозиции сортирует все возможные варианты одновременно. Поэтому на задачу, которую обычный компьютер будет решать часы, дни или даже месяцы, квантовый компьютер в теории может потратить доли секунды.

Эксперты прогнозируют, что синергия ИИ и квантовых вычислений поможет качественно прогнозировать погоду, обрабатывать естественную речь, совершенствовать голосовых помощников (понимать контекст произнесенных фраз), разрабатывать более эффективные лекарства и новые химические вещества с заданными свойствами, позволит просчитывать из множества маршрутов оптимальные и т. д.

Впрочем, не все единодушны во мнении о превосходстве квантовых компьютеров. «Ни одна из экспериментальных установок квантовых компьютеров не позволяет решать практические задачи, а стоимость таких компьютеров настолько высока, что они, скорее всего, навсегда останутся нишевым продуктом», – считает ведущий научный сотрудник Центра «Сколтеха» по научным и инженерным вычислительным технологиям для задач с большими массивами данных Игорь Захаров.

«Квантовое вычисление – это из серии «жизнь на Марсе», – согласен Гусев.

Основное препятствие для полноценного внедрения квантовых компьютеров – это пока еще высокий уровень ошибок, или так называемый шум. Зашумление в квантовых процессорах происходит из-за колебаний электромагнитного поля, температуры, различных эффектов, возникающих при взаимодействии квантовых элементов.

С шумом все успешнее борются. Так, Google представил в 2024 г. новый квантовый процессор Willow. Его разработчики утверждают, что им удалось совершить принципиальный прорыв: снизить частоту ошибок по мере масштабирования с использованием большего числа кубитов. В Google подчеркивают, что пытались решить эту задачу почти 30 лет.

В России для развития квантовых технологий есть экспериментальная база и мощные научные школы. Созданный в 2010 г. Российский квантовый центр (РКЦ) стал одним из ведущих научных центров мира не только в сфере квантовых вычислений и создания квантовых компьютеров. В РКЦ есть работающие квантовые компьютеры на четырех разных платформах: из атомов, ионов, сверхпроводников и фотонов. Сейчас размер самого мощного из них – 50 кубитов. Это не так много: мировой рекордсмен, чип Condor от компании IBM, содержит 1121 кубит. А для полноценного компьютера понадобятся миллионы кубитов.

14 января 2025 г. Microsoft включилась в дискуссию о квантовом будущем. В своем корпоративном блоге корпорация заявила, что мир находится на пороге эры квантовых вычислений, и анонсировала Quantum Ready – программу подготовки своих бизнес-клиентов к квантовым технологиям в наступившем году. «В следующие 12 месяцев темпы квантовых исследований и разработок будут только ускоряться», – утверждают в Microsoft.